Onze collega Perry Gruber (CDO) was te gast bij het Google I/O event in Mountain View, California. Hij deelde met ons zijn ervaringen en blikt vooruit op de nieuwste trends en ontwikkelingen in de wereld van Google.

"Begin deze maand ben ik naar Google I/O geweest in Mountain View California om daar de laatste ontwikkelingen van Google te bewonderen. Op deze developersconferentie werden vele nieuwe innovaties gepresenteerd op het gebied van Data & privacy, Chrome, Google Search, developer platforms: Flutter, Firebase, Google maps en nog veel meer."

"Het event werd afgetrapt met de grote Keynote van onder andere Google CEO Sundar Pichai waarin een aantal toffe dingen werden gepresenteerd. in deze blog schrijf ik over verschillende bezienswaardigheden op de Google I/O."

Duplex voor het web

Vorig jaar werd Duplex voor het eerst geïntroduceerd met als voorbeeld een geautomatiseerd telefoongesprek tussen je assistent en een restaurant om een tafel te reserveren. Deze feature kan inmiddels gebruikt worden in Amerika in een aantal staten.

Tijdens de keynote werd de volgende evolutie van het platform aangekondigd; Duplex voor het web. Duplex in het kort is een platform/systeem wat je persoonlijke data gebruikt om dingen die je wilt regelen automatiseert.

Als voorbeeld werd er die dag een huurauto geregeld voor een aankomende trip. Op basis van je profieldata in Gmail, agenda & maps kan het systeem keuzes voor je maken, zoals: Vorige gehuurde autotype of tijdstip van de geplande trips. Met als resultaat dat binnen een paar seconden na het vragen aan je telefoon "auto huren voor mijn volgende trip." Een keuze krijgt om een auto te huren, waarbij alleen nog maar op 'akkoord' geklikt hoeft te worden. Alle gegevens pre-filled en slim uitgelezen uit de beschikbare data. Handig voor de drukke stadsmens of het wekelijkse ritje naar de hockey.

Voice Assistent & the smart home

De Google assistent is een van de belangrijke pijlers binnen Google, wat steeds verder wordt geïntegreerd in verschillende platformen als ook in ons dagelijks leven. Hoewel de toepassingen zeker in de Nederlandse taal nog erg beperkt en vooral praktisch zijn, heb ik in een aantal presentaties kunnen zien wat de toekomst van Google ons te bieden heeft.

Zo was net al het Duplex for Web al een mooi voorbeeld welke geactiveerd wordt via voice. Maar zeker ook de samenwerking tussen Google en Nest gaat er voor zorgen dat het grote publiek voice meer en meer zal gaan omarmen. Door evoluties van voice en het begrijpen van context worden smart home apparaten steeds meer een hulp in huis, dan een simpele gadget.

Een hele taalbibliotheek in je broekzak

Het aansturen van een smart device of het uitvoeren van een opdracht gaat de komende tijd grote stappen maken. De interactie is op dit moment vrij traag en je moet altijd eerst 'Hey, Google' en dan je opdracht zeggen. Zo begrijpt de smart speaker met de laatste update ook context zonder 'Hey, Google.' Dus als je een alarm zet en deze loopt af roep je nu 'stop' ipv 'hey, google. Stop'.

Door het verkleinen van de NLP library (natural language processor) te verkleinen van 100GB naar 500mb waardoor het in de nieuwe smartphone van Google, de Pixel 3a kan worden geïnstalleerd, waardoor je nu zonder internet supersnel gebruik kan maken van je assistent en belangrijker nog de interactie nagenoeg real-time wordt.

Live caption

De feature die binnenkort beschikbaar komt op youtube, Google Photo's genaamd 'live-caption' vertaalt spraak real-time naar tekst. Zo kunnen zelfgemaakte video's direct worden voorzien van ondertiteling. Wat veel waarde kan hebben in bijvoorbeeld stilte ruimtes. Dit kan ook worden gebruikt voor personen die slecht kunnen praten door beperkingen. Door het gebruik van Machine Learning en voice in combinatie van live caption wordt het mogelijk real-time ondertiteling te tonen.

Intrede augumented reality (AR) in native apps

Met het steeds krachtiger worden van telefoons zie je ook dat technieken als augumenten reality steeds meer mainstream en toegankelijker worden. Hoewel de techniek al jaren bestaat is het wel nieuw dat dit straks native werkt op iedere moderne telefoon. Tijdens mijn dagen in Californië heb ik een aantal mooie voorbeelden van mogen zien.

De meest voor de hand liggende is de manier hoe je zelf over het festival terrein navigeerde middels de event app. Op verschillende plekken stond een kaart die je kon inscannen, vervolgens zag je op je telefoon waar het volgende event was die je op mijn agenda had gemarkeerd.

AR in google search is binnenkort beschikbaar. Hoewel het in eerste instantie een hoog educatie gehalte heeft, is het natuurlijk wachten om meer commerciële toepassingen. Als voorbeeld heb ik in de AR tent een Mars rover bekeken vanuit google search. De nieuwe IKEA app kon tijdens het event gebruikt worden. Waarbij nieuwe meubels direct geplaatst kunnen worden in je woonkamer, tot het lopen in een kledingwinkel waarbij ik de kleding virtueel kon passen.

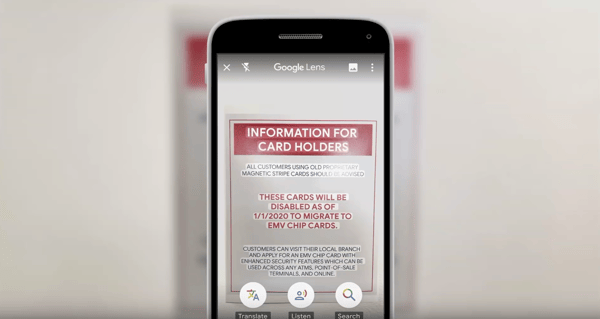

Een ander mooi voorbeeld is de live vertalingen. De use-case is hier dat, zeker in onder ontwikkelde landen waar een taal achterstand is of veel analfabeten zijn. veel wordt gemist. Doormiddel van AR, NLP & Machine Learning kan een waarschuwingsbord worden ingelezen, vertaald en vervolgens ook nog worden voorgelezen. Hiermee wordt de waarschuwing nu begrijpbaar voor personen die het eerst niet konden lezen.

Google lens die tekst herkent en kan vertalen naar een gewenste taal

Google lens die tekst herkent en kan vertalen naar een gewenste taal

Dit biedt kansen in onze branche waar nog steeds veel zaken worden weergegeven in cijfers en letters, terwijl veel mensen zaken beter begrijpen als ze die visueel voor zich zien. Denk hierbij aan een uitleg van hoe een hypotheek werkt. Of hoe een hypotheek of verzekering op dit moment in elkaar steekt. Kortom allemaal leuke UX uitdagingen!

Chrome updates - Portals

Een interessante presentatie was die van het Chrome team waarin ze een aantal bleeding edge onderdelen presenteerde die nu al beschikbaar zijn in de beta versie van het platform.

De meest opvallende was 'Portals' waarbij het probleem wordt opgelost dat je vaak informatie opnieuw moet invoeren, als je van site naar site gaat. Op veel sites kom je ergens binnen en wordt er middels een iFrame een externe pagina ingeladen met bepaalde functionaliteit. iFrame's zijn wat dit betreft 'domme' views om een andere pagina. Data kan niet zonder extra moeite van de ene naar de andere pagina. Met portals kan je een naadloze gebruikerservaring creëren, waarbij data van het ene naar het andere 'Portal' kan gaan en weer terug, waardoor je uiteindelijke een optimale gebruikersvering kan creëren.

Verder zijn de komende features erop gericht om steeds meer van vanzelfsprekende dingen uit te laten voeren door chrome in plaats van het in elk project opnieuw te coderen. Denk hierbij bijvoorbeeld aan 'lazy loading' waarbij alleen de content die in beeld wordt ingeladen en de rest pas als dit in beeld komt.

Hoewel dit grote stappen zijn voor een betere ervaring op het web hebben wij, als ontwikkelaars, nog steeds te maken met andere browsers. Helaas moet er veel tijd worden geïnvesteerd om voor iedereen een optimale gebruikerservaring te creëren.

Google Maps

In een boeiende presentatie van het Google Maps team zag je de kracht van het hebben van veel data en deze goed kunnen toepassen mooi terugkomen. De presentatie bestond uit drie onderdelen: techniek, UX en veiligheid. De feature die werd geïntroduceerd in de grote keynote "AR in Google Maps" werd hier verder toegelicht.

Exacte locatie bepaling

Eerst het stuk techniek, de telefoon van tegenwoordig is een knap staaltje techniek maar heeft zeker zijn beperkingen op het gebied van locatiebepaling. Dit vormde zeker een probleem voor de oplossing die ze wilden maken.

"Namelijk de exacte locatie van iemand in een stad, zodat diegene kan navigeren naar zijn volgende locatie"

Met de meest moderne telefoons zit er altijd een nog een verschil in van enkele tot tientallen meters.

Tot nu toe niet erg verrassend, maar door de toevoeging van analyses van miljoenen streetview afbeeldingen in combinatie met Machine learning wordt het nu mogelijk om binnen enkele seconden met je telefoon op de omgeving gericht je exacte locatie te bepalen. De snelheid waarmee dit gaat is indrukwekkend.

UX in Google Maps AR

Dan het UX gedeelte, maps kennen we nu vooral als een 2D kaart welke een beetje is gekanteld om een soort diepte gevoel te creëren. Hoe werkt dit straks met de toevoeging van AR? Hiervan werden enkele voorbeelden getoond die zijn gevalideerd en waar tegenaan gelopen werd door gebruikers. Sommige leken in het begin logisch maar na een validatie ronden eindigde deze gewoon in de prullenbak. Verder was er altijd nog de behoefte aan de huidige kaart voor algemene oriëntatie. Uiteindelijk kwam er voorlopig nog eentje als beste uit de bus.

Maps AR in de echte wereld

De techniek en manier waarop het werkt indrukwekkend, maar toch zijn er nog een aantal beperkingen, waardoor het niet in de echte wereld toegepast kan worden. 1. Het werkt nog niet in het donker 2. Mensen gaan de technologie blind vertrouwen en vergeten de veiligheid. Mede om deze redenen zal hier nog niet worden uitgerold, maar er is weinig verbeelding nodig wat voor mogelijkheden dit gaat bieden.

Onze TJIP-ers delen graag hun ervaringen of expertise. Wil jij meer weten over ons vak? Lees dan ook het verhaal van Glenn, Front-end Developer bij TJIP.